Generatív AI és adatvédelem (2. rész): Microsoft Azure környezetben hostolt LLM-ek

Az AI és az adatvédelem kapcsolatáról szóló cikkünk második részében megnézzük, hogyan lehet a Microsoft Azure környezetben elhelyezett LLM jó megoldás az adatvédelem biztosítására. A végére pedig készítettünk egy hasznos checklistát, amely segíthet az LLM-szolgáltatók adatvédelmi szempontból történő értékelésében.

Microsoft Azure környezetben hostolt LLM-ek: nagyobb ellenőrzés az adatok felett?

Azon szervezetek számára, amelyek nagyobb fokú ellenőrzést szeretnének az adataik felett, vonzó lehetőség az LLM-ek használata a Microsoft Azure-on keresztül. Az Azure felhőalapú Azure OpenAI szolgáltatást kínál, ahol az OpenAI modelljei (például a GPT-4) a Microsoft Azure adatközpontjaiban futnak, valamint lehetőséget kínál más modellek telepítésére vagy akár saját modellek finomhangolására és hosztolására is. Az Azure-hostolt LLM többféle módon is segíthet az adatvédelmi aggályok kezelésében:

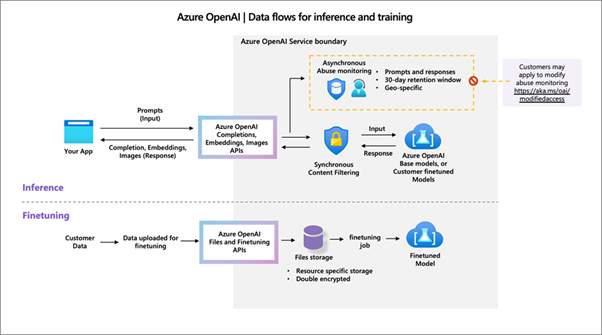

Adatáramlás az Azure OpenAI szolgáltatásban: látható, hogy az ügyfél minden kérése és kiegészítése az Azure környezetében marad. Az adatok feldolgozása az Azure OpenAI szolgáltatás határain belül történik (régióspecifikus kezeléssel és a visszaélések nyomon követése céljából alapértelmezett 30 napos megőrzéssel), és nem kerülnek megosztásra sem az OpenAI-jal, sem más ügyféllel. A finombeállítási adatokat egy erre a célra fenntartott, titkosított helyen tárolják, és minden finomhangolt modell kizárólag az ügyfél számára elérhető.

- Adatrezidencia és -szuverenitás: az Azure-ön telepített OpenAI számára kiválaszthatja régióját (pl. Nyugat-Európa, Észak-Európa, Németország stb.). A Microsoft garantálja, hogy az összes nyugvó ügyféladat az Ön által kiválasztott régióban marad. Az európai vállalatok számára ez azt jelenti, hogy az EU régió kiválasztásával biztosíthatja, hogy az adatok az EU határain belül maradjanak. (Figyeljen arra, hogy olyan modelltelepítéseket válasszon, amelyek régióspecifikusak – az Azure megjegyzi, hogy egyes globálisan terjesztett modellek más régiókban is feldolgozhatnak adatokat, ezért a megfelelőség érdekében válasszon régióspecifikus opciót). Az adatok régión belüli tárolásával elkerülheti a GDPR szerinti nemzetközi adattovábbítás bonyolultságát. A Microsoft szolgáltatásait általában úgy tervezték, hogy megfeleljenek az uniós adatvédelmi követelményeknek, és a Microsoft szerződéses kötelezettségeket vállal ügyfelei számára a GDPR tekintetében.

- Nincs adatmegosztás az OpenAI-jal vagy másokkal: Az Azure menedzselt szolgáltatásának nagy előnye az adatok elszigetelése. A Microsoft szerint az Azure OpenAI használata esetén az Ön által adott felkérések, kitöltések, beágyazások és képzési adatok más ügyfelek számára nem hozzáférhetőek, és egyáltalán nem kerülnek elküldésre az OpenAI-nak (a vállalatnak). Sőt, kifejezetten kijelentik, hogy az Ön adatait nem használják fel sem az OpenAI, sem a Microsoft modelljeinek, sem harmadik fél szolgáltatásainak javítására. Az Azure-ban futó OpenAI-modell lényegében egy biztonságos másolat, amely a Microsoft felhőjében fut – a szolgáltatás nem hívja fel az OpenAI szervereit. Ez azt jelenti, hogy a kapcsolat egyszerű: az Ön cége (adatkezelő) -> Microsoft (adatfeldolgozó). Az OpenAI mint külső fél nem vesz részt az adatáramlásban, ami egyszerűsítheti az adatvédelmi rendelkezéseket (a Microsoft szabványos online szolgáltatási feltételei vonatkoznak rá, amelyek alapértelmezés szerint tartalmazzák a GDPR feltételeit és gyakran az EU szabványos szerződési feltételeit).

- Finomhangolás, egyéni modellek és az adatvédelem: Az Azure OpenAI lehetővé teszi a modellek finomhangolását a saját adatain, biztonságosan. Amikor a finomhangoláshoz feltölti a képzési adatokat, azokat egy elszigetelt Azure Storage-példányban tárolják az Ön régiójában, és titkosítva vannak (az Azure dokumentáció szerint akár kétszeresen is titkosítva). Az így kapott finomhangolt modell kizárólag az Ön számára elérhető – nem kerül megosztásra vagy más Azure-ügyfelek javára felhasználásra. Ez fontos, hiszen ha Ön befektet egy AI testreszabásába a saját adatain, nem szeretné, ha ezek az adatok vagy a finomhangolt modell kiszivárogna. Az Azure biztosítja, hogy az az Ön tulajdona maradjon. A GDPR szempontjából a képzési anyagban szereplő személyes adatok továbbra is az Ön ellenőrzése alatt maradnak, és ha végzett, törölheti a képzési adatokat a tárolóból. A Microsoft, mint adatfeldolgozó, az Ön utasításai szerint jár el, hogy szükség szerint eltávolítsa vagy megőrizze azokat.

Tehát az Azure-on hostolt LLM-ek használata lehetőséget nyújt a vállalatoknak arra, hogy a legmodernebb mesterséges intelligenciát a vállalati szintű biztonság és megfelelőség keretein belül használják ki. Ön élvezheti a felhő skálázhatóságának és fejlett modelljeinek előnyeit, de lehetősége van arra, hogy mindent lezárva tartson: az adatok Európában maradnak, csak az Ön szervezete férhet hozzá, semmi nem jut vissza a modellszolgáltatóhoz, és a felügyelethez naplózási adatok állnak rendelkezésre. Ez természetesen extra összetettséggel és költségekkel jár.

Ellenőrző lista – ha nem az OpenAI-t választja

Végül, az alábbiakban egy általunk készített ellenőrző listát talál, amelyet LLM-szolgáltatók értékeléséhez használhat, ha úgy dönt, hogy az OpenAi helyett egy másik LLM-szolgáltatót választ.

1. Jogi szerep és szerződéskötés

- Csak feldolgozó? A szállító megerősíti, hogy a GDPR értelmében kizárólag adatfeldolgozóként fog eljárni, az Ön szervezete pedig továbbra is adatkezelő marad? CNILEurópai Adatvédelmi Testület

- Uniós képviselő / telephely? Ha az eladó az EU-n kívül van, megnevez-e uniós képviselőt, és támaszkodik-e a szabványos szerződési záradékokra (SCC) vagy az EU és az USA közötti adatvédelmi keretrendszerre az adattovábbítások esetében? Európai Adatvédelmi Testület

- Egyértelmű alvállalkozói lista? Minden továbbfeldolgozó szolgáltatót nyilvánosságra hoznak, előzetes bejelentési/lemondási joggal minden változtatásra vonatkozóan?

2. Adathasználat és adatmegőrzés

- Alapértelmezés szerint nincs képzés az adatokról (csak opt-in)? Ellenőrizze a szabályzatot; lehetőleg ne kelljen ezt külön megtiltania. Mesterséges intelligenciáról szóló törvény

- Konfigurálható adatmegőrzési idő? A 30 napos vagy rövidebb naplók elfogadhatóak, az érzékeny munkamenetek esetében nulla megőrzési lehetőséggel.

- Kérésre történő biztonságos törlés? A bemenetek, kimenetek és minden finomhangolási objektum törlésre kerülhet, amikor Ön távozik (vagy ha szükséges, hamarabb is)?

3. Adatrezidencia és adattovábbítás

- EU-s adatrezidencia lehetősége? A szolgáltató garantálni tudja, hogy a következtetés és a tárolt adatok az Ön által kiválasztott EU-s földrajzi területen belül maradnak (nincs rejtett replikáció)?

- Átlátható adatáramlási térkép? Végponttól végpontig tartó diagram mutatja, hogy az adatok hova kerülnek továbbításra és tárolásra (beleértve a biztonsági mentéseket is)?

Az Ön cégénél milyen AI-eszközöket használnak? Milyen tapasztalatai vannak az OpenAI-n és a Microsoft eszközein kívül? Vannak olyanok, amelyek a magas kockázatúak közé sorolhatók az uniós AI-rendelet szerint?