Generative KI & Datenschutz (Teil 2): Microsoft Azure-gehostetes LLM

Im zweiten Teil unseres Blogbeitrags werden wir speziell darauf eingehen, wie ein in der Microsoft Azure-Umgebung gehostetes LLM eine gute Lösung zur Gewährleistung des Datenschutzes sein kann. Außerdem haben wir eine nützliche Checkliste für Unternehmen erstellt, um LLM-Anbieter zu bewerten.

Wie ein Microsoft Azure-gehostetes LLM Ihnen mehr Kontrolle über Ihre Daten geben kann

Für Unternehmen, die ein zusätzliches Maß an Kontrolle über ihre Daten wünschen, ist die Verwendung von LLMs über Microsoft Azure eine attraktive Option. Azure bietet den Azure OpenAI Service, einen Cloud-basierten Dienst, bei dem die OpenAI-Modelle (wie GPT-4) in den Azure-Rechenzentren von Microsoft ausgeführt werden, sowie Optionen zur Bereitstellung anderer Modelle oder sogar zur Feinabstimmung und zum Hosten Ihrer eigenen Modelle. Die Entscheidung für ein von Azure gehostetes LLM kann in mehrfacher Hinsicht dazu beitragen, Bedenken hinsichtlich des Datenschutzes auszuräumen:

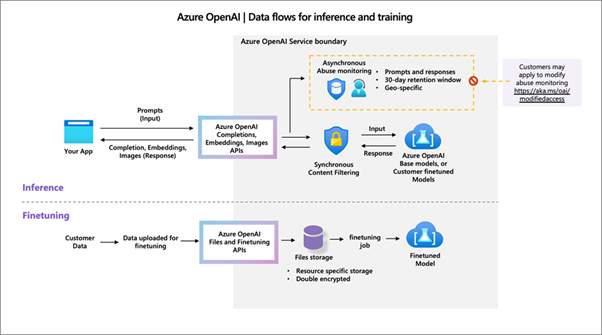

Datenfluss im Azure OpenAI Service für Inferenz und Feinabstimmung, der zeigt, dass alle Kundenaufforderungen und Vervollständigungen innerhalb der Azure-Umgebung bleiben. Die Daten werden innerhalb der Grenzen des Azure OpenAI Service verarbeitet (mit regionsspezifischer Handhabung und einer standardmäßigen 30-tägigen Aufbewahrung für die Missbrauchsüberwachung) und werden weder mit OpenAI noch mit anderen Kunden geteilt. Feinabstimmungsdaten werden an einem speziellen, verschlüsselten Ort gespeichert, und jedes feinabgestimmte Modell ist ausschließlich für den Kunden verfügbar.

- Datenresidenz und -Souveränität: Wenn Sie ein LLM über Azure bereitstellen, können Sie die Region (z. B. Westeuropa, Nordeuropa, Deutschland usw.) für Ihre Azure OpenAI-Instanz auswählen. Microsoft garantiert, dass alle gespeicherten Kundendaten in der von Ihnen gewählten Region verbleiben. Für europäische Unternehmen bedeutet dies, dass Sie sicherstellen können, dass die Daten innerhalb der EU-Grenzen bleiben, indem Sie eine EU-Region auswählen. (Achten Sie darauf, Modellimplementierungen zu wählen, die regionalspezifisch sind – Azure weist darauf hin, dass einige global verteilte Modelle Daten in anderen Regionen verarbeiten können, wählen Sie also eine regionalspezifische Option, um die Compliance zu gewährleisten). Indem Sie die Daten in der Region halten, vermeiden Sie die Komplexität des internationalen Datentransfers gemäß DSGVO. Die Dienste von Microsoft sind im Allgemeinen so konzipiert, dass sie die Datenschutzanforderungen der EU erfüllen, und Microsoft hat sich vertraglich zur Einhaltung der DSGVO für seine Kunden verpflichtet.

- Keine gemeinsame Nutzung mit OpenAI oder anderen: Ein großer Vorteil des verwalteten Dienstes von Azure ist die Isolierung Ihrer Daten. Laut Microsoft sind Ihre Eingabeaufforderungen, Vervollständigungen, Einbettungen und Trainingsdaten bei der Nutzung von Azure OpenAI für andere Kunden nicht zugänglich und werden nicht an OpenAI (das Unternehmen) gesendet. Es wird sogar ausdrücklich darauf hingewiesen, dass Ihre Daten weder zur Verbesserung der Modelle von OpenAI noch der Modelle von Microsoft oder von Diensten Dritter verwendet werden. Die OpenAI-Modelle, die in Azure laufen, sind im Wesentlichen eine gesicherte Kopie, die in Microsofts Cloud läuft – der Dienst ruft nicht die Server von OpenAI auf. Das heißt, die Beziehung ist einfach: Ihr Unternehmen (Controller) -> Microsoft (Prozessor). OpenAI ist als externe Partei nicht in den Datenfluss involviert, was DPA-Vereinbarungen vereinfachen kann (es wird von Microsofts Standardbedingungen für Online-Dienste abgedeckt, die standardmäßig DSGVO-Bedingungen und oft die EU-Standardvertragsklauseln enthalten).

- Feinabstimmung und benutzerdefinierte Modelle mit Datenschutz: Azure OpenAI ermöglicht Ihnen eine sichere Feinabstimmung von Modellen mit Ihren eigenen Daten. Wenn Sie Trainingsdaten für die Feinabstimmung hochladen, werden diese in einer isolierten Azure-Storage-Instanz in Ihrer Region gespeichert und verschlüsselt (laut Azure-Dokumentation sogar doppelt verschlüsselt). Das daraus resultierende fein abgestimmte Modell steht ausschließlich Ihnen zur Verfügung – es wird nicht weitergegeben oder zum Nutzen anderer Azure-Kunden verwendet. Dies ist wichtig: Wenn Sie in die Anpassung einer KI an Ihre eigenen Daten investieren, möchten Sie nicht, dass diese Daten oder das abgestimmte Modell nach außen dringen. Azure stellt sicher, dass sie Ihr Eigentum bleiben. Aus Sicht der DSGVO haben Sie weiterhin die Kontrolle über alle personenbezogenen Daten im Schulungsmaterial, und Sie können die Schulungsdaten nach Abschluss der Schulung aus dem Speicher löschen. Microsoft als Datenverarbeiter wird auf Ihre Anweisungen hin handeln und die Daten je nach Bedarf entfernen oder aufbewahren.

Im Wesentlichen bietet die Verwendung von auf Azure gehosteten LLMs Unternehmen die Möglichkeit, modernste KI innerhalb eines Rahmens von Sicherheit und Compliance auf Unternehmensniveau zu nutzen. Sie profitieren von der Skalierbarkeit der Cloud und fortschrittlichen Modellen, haben aber auch die Möglichkeit, alles unter Verschluss zu halten: Die Daten bleiben in Europa, nur Ihre Organisation hat Zugriff darauf, nichts wird an den Modellanbieter zurückgesendet, und Sie haben Protokolle zur Überwachung. Natürlich ist dies mit zusätzlicher Komplexität und Kosten verbunden.

KI-Anbieter und Datenschutz – Checkliste

Nachfolgend finden Sie eine Checkliste, die wir erstellt haben und die Sie verwenden können, um andere LLM-Anbieter zu bewerten, wenn Sie sich für einen anderen Anbieter als OpenAI entscheiden.

1. Rechtliche Rolle & Vertragsgestaltung

- Nur Datenverarbeitung? Der Anbieter bestätigt, dass er im Rahmen der DSGVO lediglich als Datenverarbeiter fungiert, während Ihr Unternehmen der für die Verarbeitung Verantwortliche bleibt.

- EU-Repräsentanz vorhanden? Wenn der Anbieter außerhalb der EU ansässig ist, benennt er dann einen EU-Vertreter und stützt sich bei der Übermittlung auf die Standardvertragsklauseln (SCC) oder den EU-US-Datenschutzrahmen?

- Klare Liste der Unterauftragsverarbeiter? Alle nachgelagerten Dienstleister werden offengelegt, mit dem Recht auf Vorankündigung/Opt-out für etwaige Änderungen.

2. Datennutzung und -Aufbewahrung

- Standardmäßig keine Trainings mit Ihren Daten (nur Opt-in)? Prüfen Sie die Richtlinie; Sie sollten sich nicht abmelden müssen. Gesetz über künstliche Intelligenz.

- Konfigurierbares Aufbewahrungsfenster? 30 Tage oder kürzere Protokolle sind akzeptabel, mit einer Null-Aufbewahrungsoption für sensible Arbeitslasten.

- Sichere Löschung auf Anfrage? Eingaben, Ausgaben und alle Artefakte der Feinabstimmung können gelöscht werden, wenn Sie gehen oder bei Bedarf auch früher.

3. Datenresidenz und Datenübertragungen

- EU-Datenresidenz-Option? Der Anbieter kann garantieren, dass die Ableitung und alle gespeicherten Daten innerhalb der von Ihnen gewählten EU-Geografie bleiben (keine versteckte Replikation).

- Transparente Datenflusskarte? End-to-End-Diagramm zeigt, wohin die Daten geleitet und gespeichert werden (inkl. Backups).

Welche LLMs (oder weitere AI-Tools) nutzen Sie? Welche Erfahrungen haben Sie jenseits von OpenAI und Microsoft gemacht – und wie würden diese im AI Act eingestuft? Warum sprechen wir nicht darüber?