Databricks-bevezetés vezetői szemmel: hogy érdemes nekifogni?

Három napja várja az üzlet a válaszokat.

A riportok készen vannak, de senki nem tudja biztosan, melyik számoknak higgyünk. Ki a data owner? Hogy definiáljuk ezt a mérőszámot?

A sok adattal dolgozó szervezeteknél – bankok, biztosítók, telco cégek – ez nem ritka jelenet. A rengeteg adat itt nem versenyelőny: inkább kockázat, költség és szervezeti feszültség, ha nincs mögötte egy olyan működés, ami gyorsan és biztonságosan alakítja át az adatot üzleti döntéssé. Szabályozott környezetben pedig különösen igaz, hogy az adat nemcsak érték, hanem compliance-kockázat is.

Mit lát ebből egy üzleti döntéshozó?

Vezetői szinten a kérdések általában nem a technológia szintjén merülnek fel. Nem az a kérdés, hogy Spark vagy SQL, hanem sokkal inkább az, hogy

- Mennyi idő, mire egy új üzleti kérdésre adatalapú választ kapunk?

- Mennyire bízhatok a számokban (adatminőség, definíciók, auditálhatóság)?

- Mennyibe kerül mindez (infrastruktúra + emberóra + rejtett működési költségek)?

- Mennyire biztonságos és szabályozás-kompatibilis (GDPR, DORA, audit, jogosultságkezelés)?

Ha ezekre a kérdésekre nincs egyértelmű válasz, az „adatvezérelt működés” inkább fékezi, mint gyorsítja a szervezetet.

A megoldás: Databricks

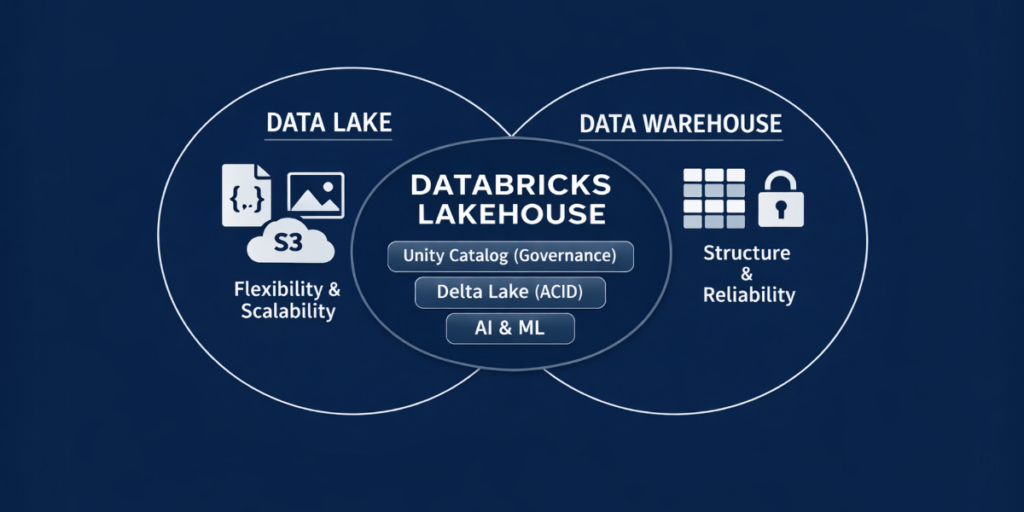

A fenti kihívásokra az egyik lehetséges válasz a Databricks, a világ első Data Intelligence Platformja, amely a modern Lakehouse architektúrára épül. Megszünteti a silókat az adattárolásban: egyesíti az adattárházak (Data Warehouse) megbízhatóságát és struktúráját az adattavak (Data Lake) rugalmasságával és skálázhatóságával. Így nem kell választani rugalmasság és kontroll között: strukturált és nem strukturált adatok egyaránt kezelhetők, miközben megmarad a visszakövethetőség és az adatminőség.

A Databricks az alábbiaknak köszönhetően vált néhány év alatt piaci standarddá:

- Megszünteti az adattárolási és feldolgozási silókat: Egyetlen felületen kezelhető az adatkinyerés (ETL), az adattárolás, a BI riportálás és a gépi tanulás (Machine Learning).

- Nyílt szabványok: Nincs „vendor lock-in”. A Delta Lake és az Apache Spark technológiákra építve az adatok mindig az Ön tulajdonában maradnak, nyílt formátumban.

- Beépített Governance: A Unity Catalog segítségével a teljes szervezet adatvagyona felett központosított kontrollt gyakorolhat, ami elengedhetetlen a DORA és a GDPR megfeleléshez.

Ráadásul a fejlesztők is szeretik, mert drasztikusan növeli a produktivitást:

- Multi-language támogatás: A fejlesztők szabadon választhatnak a Python, SQL, R és Scala nyelvek között ugyanazon a munkafelületen.

- Collaborative Notebooks: Valós idejű közös kódolás, verziókezelés és interaktív vizualizáció, ami felgyorsítja az ötlettől a termelésig vezető utat.

- Szerver nélküli (Serverless) számítás: Nem kell az infrastruktúra menedzselésével tölteni az időt – a platform automatikusan skálázódik az adatmennyiséghez mérten.

Min csúszhat el a Databricks-bevezetés – és hogyan érdemes belevágni?

Sok Databricks program ott csúszik el, hogy IT-projektként indul, miközben valójában üzleti képességet kellene építeni. Néhány tipikus buktató:

- nincs világos üzleti fókusz,

- a governance utólag kerül rá,

- az implementáció IT-projektként fut,

- nincs tiszta együttműködés a belső és külső szereplők között.

Tapasztalatunk, hogy azok a Databricks-bevezetések működnek jól, ahol:

- van üzletileg értelmezhető use case már az elején,

- világos, mit jelent a siker (idő, minőség, kockázat, költség),

- a governance az alapok része (nem utólag kerül be),

- és a szervezet nem függ hosszú távon külső szereplőktől.

Hogyan érdemes belevágni? Ez a megközelítés jellemzően működik:

- Kezdjenek 1-2 üzletileg éles use case-szel, ahol a siker mérhető (pl. fraud jelzés pontosság/átfutás; ügyfélérték-szegmentálás; hálózati hibák előrejelzése).

- Definiáljanak vezetői KPI-okat már az elején (átfutási idő, minőség, költség, kockázat).

- Tegyék tisztába a “ki dönt miben” kérdést: data ownership, definíciók, hozzáférés, változáskezelés.

- Ne akarjanak mindent egyszerre migrálni. A “big bang” ritkán működik jól, különösen a szabályozott iparágakban.

Databricks tanácsadás a DSS szerint: mit csinálunk másképp?

A DSS Consulting, mint regisztrált Databricks tanácsadó partner , nem „platformbevezetésként”, hanem üzleti transzformációként kezeli a Databricks-bevezetést. Néhány kulcselem ebből a szemléletből:

- Shift-left governance: A minőség, jogosultságkezelés és kontroll nem a projekt végén jelenik meg, hanem már a pipeline-ok tervezésénél.

- Fix áras pilot, valódi use case-szel: 3–4 hónap alatt kézzelfogható üzleti eredményt hozunk (pl. fraud detection, kárstatisztika), kontrollált kockázattal.

- Data product gondolkodás: Az adat nem melléktermék, hanem újrahasznosítható, ownership-alapú termék, mérhető megtérüléssel.

- Tudástranszfer, nem függőség: A cél az, hogy az ügyfél belső csapatai hosszú távon önállóan működtessék a platformot.

Így néz ki nálunk a Databricks-bevezetés folyamata a gyakorlatban:

- Stratégia és célarchitektúra review

Use case-ek priorizálása, MVP scope, governance alapelvek már az elején. - Platformalapok kontrollal

Biztonságos workspace-ek, hálózati izoláció, IaC standardok, költség- és usage-kontroll. - Shift-left governance és DataOps

Unity Catalog, jogosultságkezelés, CI/CD, data quality és tesztelési standardok nem utólag, hanem beépítve. - Iteratív fejlesztés és migráció

Nem “big bang”, hanem fokozatos kiváltás, mérhető üzleti eredményekkel. - Üzemeltetés és optimalizálás

Monitoring, incidenskezelés, költség- és teljesítmény-finomhangolás.

Miért fontos ez vezetői szinten? Mert így a Databricks nem „még egy platform” lesz, hanem:

- gyorsabb time-to-insight,

- kevesebb adatvita és manuális workaround,

- auditálható, átlátható működés,

- és hosszú távon alacsonyabb működési kockázat.

A fix áras pilot megközelítés (3–4 hónap alatt működő üzleti use case) pedig lehetőséget ad arra, hogy kontrollált kockázat mellett kézzelfogható eredményt lássunk – ne csak ígéreteket.

Végül, egy rövid vezetői checklista…

Ha Databricks-bevezetésben (vagy más modern adatplatformban) gondolkodik, érdemes válaszolni az alábbi kérdésekre:

- Hol a legdrágább ma a lassú adat?

- Hol keletkezik a legtöbb manuális adatkezelés?

- Mely pontokon a legnagyobb a compliance- és auditkockázat?

- Mi az az eredmény, ami 90 napon belül vezetői szinten is látszik?

Ha ezekre a kérdésekre van válasza, a technológiai döntés is jóval könnyebb lesz.

Sok adattal dolgozó iparágakban (elsősorban banki, biztosítói, telco környezetben) a data platform kérdése valójában üzleti gyorsaság és kontroll kérdése. A Databricks erős eszköz lehet ebben – de az igazi nyereség akkor jön, ha a bevezetés üzleti célokra, mérhető eredményekre és működési keretekre épül.

Az Ön cégénél is lenne igény egy egységes, a szabályozásoknak megfelelő, és az AI/ML alkalmazásokat is támogató adatplatformra? Miért ne beszélgessünk erről egy kávé mellett?